- Kampus Berkomitmen Berdampak melalui Kehadiran Tokoh Legislatif

- Perlengkapan canggih diserahkan untuk memperkuat keamanan daerah

- Akreditasi Baik Sekali diraih

- Gerakan lingkungan diperkuat, desa dan kelurahan berprestasi menerima insentif berseri

- Gagasan Strategis Unggul Raih Penghargaan Terbaik di Lembaga Pendidikan Perwira

- Arah Baru Pembangunan Daerah Diperkuat

- Tradisi menyemarakkan puncak perayaan ke-770

- Delapan TKP Berakhir, Tewas Saat Diamankan

- Peringatan 770 Tahun Diselenggarakan Sederhana, Arah Tumbuh Semakin Tangguh

- Ketangguhan Masyarakat Teruji di Tengah Erupsi Tanpa Korban Jiwa

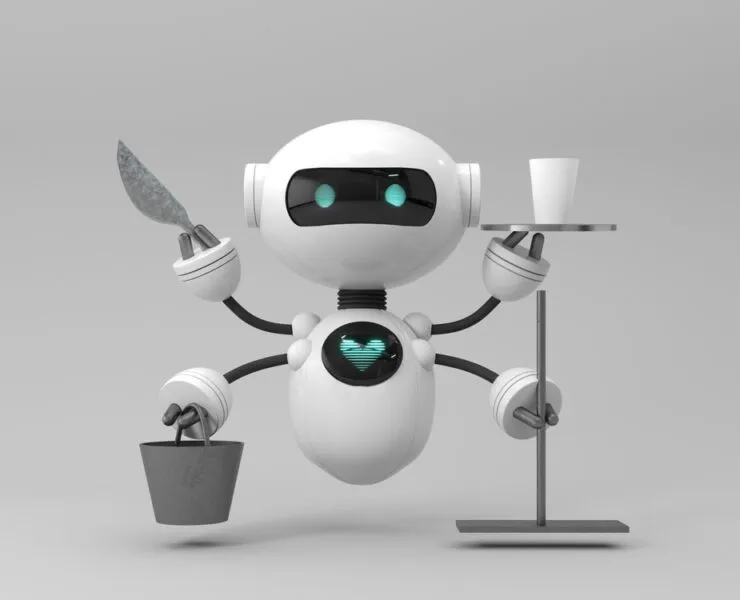

Meta Merilis V-JEPA, Model Visi Prediktif yang Canggih

Meta releases V-JEPA, a predictive vision model https://dailyai.com/2024/02/meta-releases-v-jepa-a-predictive-vision-model/

Keterangan Gambar : Meta Merilis V-JEPA,

Meta telah merilis V-JEPA, sebuah model visi prediktif yang merupakan langkah selanjutnya menuju visi Kepala Ilmuwan Kecerdasan Buatan Meta, Yann LeCun, tentang kecerdasan mesin yang canggih (AMI).

Untuk mesin yang didukung kecerdasan buatan dapat berinteraksi dengan objek di dunia fisik, mereka perlu dilatih, namun metode konvensional sangat tidak efisien. Mereka menggunakan ribuan contoh video dengan pengode gambar pra-terlatih, teks, atau anotasi manusia, agar mesin dapat mempelajari satu konsep, apalagi beberapa keterampilan.

V-JEPA, yang merupakan singkatan dari Joint Embedding Predictive Architectures, adalah model visi yang dirancang untuk mempelajari konsep-konsep ini dengan cara yang lebih efisien.

LeCun mengatakan bahwa "V-JEPA adalah langkah menuju pemahaman yang lebih kuat tentang dunia sehingga mesin dapat mencapai pemikiran dan perencanaan yang lebih umum."

V-JEPA mempelajari bagaimana objek di dunia fisik berinteraksi dengan cara yang sama seperti manusia. Bagian kunci dari cara kita belajar adalah dengan mengisi kekosongan untuk memprediksi informasi yang hilang. Ketika seseorang berjalan di belakang layar dan keluar di sisi lain, otak kita mengisi kekosongan dengan pemahaman tentang apa yang terjadi di belakang layar.

V-JEPA adalah model non-generative yang belajar dengan memprediksi bagian video yang hilang atau tersembunyi. Model generatif dapat membuat kembali potongan video yang tersembunyi pixel demi pixel, tetapi V-JEPA tidak melakukannya.

Ia membandingkan representasi abstrak dari gambar yang tidak berlabel daripada pixel itu sendiri. V-JEPA diberikan video yang memiliki sebagian besar bagian yang tersembunyi, dengan cukup video untuk memberikan konteks. Model kemudian diminta untuk memberikan deskripsi abstrak tentang apa yang terjadi di ruang yang tersembunyi.

Alih-alih dilatih pada satu keterampilan tertentu, Meta mengatakan "itu menggunakan pelatihan mandiri pada sejumlah video dan mempelajari sejumlah hal tentang bagaimana dunia bekerja."

Hari ini kami merilis V-JEPA, sebuah metode untuk mengajarkan mesin memahami dan memodelkan dunia fisik dengan menonton video. Ini adalah langkah penting lainnya menuju visi model kecerdasan buatan yang menggunakan pemahaman yang dipelajari tentang dunia untuk merencanakan, berpikir, dan...

Evaluasi beku

Makalah penelitian Meta menjelaskan bahwa salah satu hal kunci yang membuat V-JEPA jauh lebih efisien daripada beberapa model pembelajaran visi lainnya adalah seberapa baiknya dalam "evaluasi beku".

Setelah menjalani pembelajaran mandiri dengan data yang tidak berlabel secara ekstensif, enkoder dan prediktor tidak memerlukan pelatihan lebih lanjut saat mempelajari keterampilan baru. Model yang telah dipelajari sebelumnya dibekukan.

Sebelumnya, jika Anda ingin menyesuaikan model untuk mempelajari keterampilan baru, Anda perlu memperbarui parameter atau bobot seluruh model. Agar V-JEPA dapat mempelajari tugas baru, hanya diperlukan sejumlah kecil data berlabel dengan hanya sejumlah kecil parameter khusus tugas yang dioptimalkan di atas tulang punggung yang dibekukan.

Kemampuan V-JEPA untuk belajar tugas baru dengan efisien menjanjikan untuk pengembangan kecerdasan buatan yang terwujud. Ini bisa menjadi kunci untuk memungkinkan mesin untuk memiliki kesadaran kontekstual terhadap lingkungan fisik mereka dan menangani perencanaan serta tugas pengambilan keputusan berurutan.

Sumber: https://twitter.com/AIatMeta/status/1493660730730739715